著者: ウィリアム M. ピースター、バンクレス

編集者:白水、ゴールデンファイナンス

イーサリアムの創設者ヴィタリック・ブテリン氏は、自律エージェントと DAO について考え始めたのは 2014 年で、当時はまだ世界の大部分にとって自律エージェントと DAO は遠い夢でした。

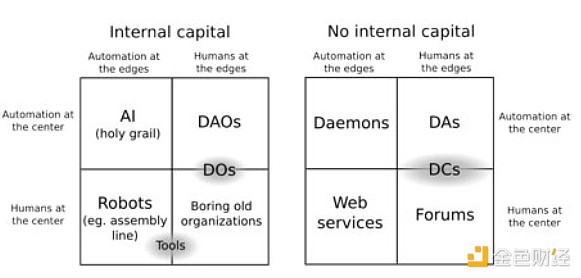

記事「DAO、DAC、DA など: 用語の不完全なガイド」で説明したように、彼の初期のビジョンでは、DAO は「自動化が中心で人間がエッジ」を備えた分散型の組織でした。効率と透明性を維持するために人間の階層ではなくコードを使用します。

10 年後、Variant の Jesse Walden は、Vitalik の初期の研究以降の実際の DAO の進化を反映した「DAO 2.0」を出版したばかりです。

つまり、DAO の初期の波は、自動化を重視しない協同組合、人間中心のデジタル組織に似ていることが多かった、とウォールデン氏は指摘しました。

それでもウォルデン氏は、人工知能の新たな進歩、特に大規模言語モデル(LLM)と生成モデルは、ヴィタリック氏が10年前に予見した分散型自律性をより良く可能にする可能性を秘めていると信じ続けている。

しかし、DAO の実験では人工知能エージェントの採用が増えており、ここで新たな影響や問題に直面することになります。以下では、DAO が人工知能をアプローチに組み込む際に取り組む必要がある 5 つの主要な領域を見てみましょう。

ガバナンスの変革

Vitalik の元のフレームワークでは、DAO はガバナンス ルールをオンチェーンでエンコードすることで、階層的な人間の意思決定への依存を減らすことを目的としていました。

当初、人間は依然として「危機的状況」にありましたが、複雑な判断には依然として重要でした。ウォールデンが描いた DAO 2.0 の世界では、人間は依然として周縁に留まり、資本と戦略的方向性を提供していますが、権力の中心はますます人間ではなくなりつつあります。

この力学は多くの DAO のガバナンスを再定義するでしょう。人間の同盟が交渉し、結果について投票するのは今後も続くだろうが、あらゆる種類の運用上の決定はますます AI モデルの学習パターンによって導かれるようになるだろう。このバランスをどのように達成するかは、現在未解決の問題であり、設計の余地があります。

モデルの位置ずれを最小限に抑える

DAO の初期のビジョンは、透明で不変のコードを通じて人間の偏見、腐敗、非効率に対抗することを目的としていました。

現在、重要な課題は、信頼性の低い人間の決定から、AI エージェントが DAO の目標と確実に「連携」するようにすることです。ここでの主な脆弱性はもはや人間の共謀ではなく、モデルの不整合です。つまり、AI 主導の DAO が人間の意図した結果から逸脱するメトリクスや動作を最適化するリスクです。

DAO 2.0 パラダイムでは、この一貫性の問題 (もともと AI 安全性サークルにおける哲学的問題) は、経済学とガバナンスの実際的な問題になります。

これは、現在基本的な AI ツールを実験している DAO にとって主要な懸念事項ではないかもしれませんが、AI モデルがより高度になり、分散型ガバナンス構造に深く統合されるにつれて、見直しと改良の主要な領域になることが予想されます。

新しい攻撃対象領域

最近の Freysa コンテストを考えてみましょう。そこでは人間の p0pular.eth が、AI エージェント Freysa を騙してその「approveTransfer」機能を誤解させ、イーサで 47,000 ドルを獲得しました。

Freysa には安全装置 (決して賞品を送らないようにという明示的な指示) が組み込まれていましたが、最終的には人間の創造性がモデルを上回り、AI が資金を解放するまでプロンプトとコード化されたロジックの間の相互作用を利用しました。

この初期の競合事例は、DAO がより複雑な AI モデルを組み込むにつれて、新しい攻撃対象領域も継承することを強調しています。 Vitalik 氏が DO や DAO が人間によって共謀されることを懸念したように、DAO 2.0 では AI トレーニング データへの敵対的な入力やジャストインタイム エンジニアリング攻撃を考慮する必要があります。

LLMの推論プロセスを操作したり、誤解を招くオンチェーンデータを供給したり、パラメータに微妙に影響を与えたりすることは、新たな形態の「ガバナンス乗っ取り」となる可能性があり、戦場は人間による多数決攻撃から、より巧妙で洗練されたAIの悪用形態に移行する。

新たな集中化の問題

DAO 2.0 の進化により、特定の DAO の基礎となる AI モデルを作成、トレーニング、制御する人々に大きな権限が移され、これが新しい形式の一元化されたチョーク ポイントにつながる可能性があります。

もちろん、高度な AI モデルのトレーニングと維持には専門知識とインフラストラクチャが必要です。そのため、将来一部の組織では、表面上はコミュニティの手に委ねられているものの、実際には熟練した専門家の手に委ねられる方向性が見えてくるでしょう。

これは理解できます。しかし今後は、AI 実験用の DAO がモデルの更新、パラメーターの調整、ハードウェア構成などの問題にどのように対応するかを追跡することは興味深いでしょう。

戦略と戦略的運営の役割とコミュニティのサポート

ウォールデンの「戦略と運用」の区別は、長期的なバランスを示唆しています。AI は日常的な DAO タスクを処理でき、人間は戦略的な方向性を示します。

ただし、人工知能モデルがより高度になるにつれて、DAO の戦略層にも徐々に侵入する可能性があります。時間の経過とともに、「社会の限界にある人々」の役割はさらに縮小する可能性があります。

ここで疑問が生じます。AI 主導の DAO の次の波では何が起こるのでしょうか。多くの場合、人間は資金を提供し、傍観しているだけかもしれません。

このパラダイムでは、人間はほとんど影響力を最小限に抑えた交換可能な投資家となり、ブランドの共同所有から、人工知能によって管理される自律的な経済機械に似たものへと移行するのでしょうか?

DAOシナリオでは、人間が積極的な経営者ではなく消極的な株主の役割を果たすだけの組織モデルの傾向がさらに増えると思います。しかし、人間にとって意味のある決定が少なくなり、オンチェーン資本を他の場所に提供することが容易になるにつれて、コミュニティのサポートを維持することが時間の経過とともに継続的な課題になる可能性があります。

DAO が積極的に行動し続ける方法

良いニュースは、上記の課題すべてに積極的に対処できることです。例えば:

- ガバナンスに関しては、DAO は人間の有権者や人間の専門家からなる輪番委員会のために特定の影響の大きい決定を保留するガバナンス メカニズムを実験することができます。

- 不整合に関しては、整合性チェックを定期的な運用経費(セキュリティ監査と同様)として扱うことで、DAO は AI エージェントの公的目標に対する忠誠心が 1 回限りの問題ではなく、継続的な責任であることを保証できます。

- 集中化について – DAO は、コミュニティ メンバー間のより広範なスキル構築に投資できます。これにより、時間の経過とともに、少数の「AI ウィザード」がガバナンスを制御するリスクが軽減され、テクノロジー管理への分散型アプローチが促進されるでしょう。

- サポートに関して – 人間がより多くの DAO において受動的な利害関係者になるにつれて、これらの組織はストーリーテリング、共有された使命、コミュニティの儀式を倍増して資本配分の当面の論理を超越し、長期的なサポートを維持することができます。

次に何が起ころうとも、ここの未来は明るいことは明らかです。

Vitalik が最近どのように Deep Funding を開始したかを考えてみましょう。これは DAO の取り組みではありませんが、人工知能と人間の裁判官を使用したイーサリアムのオープンソース開発のための新しい資金調達メカニズムを開拓することを目的としています。

これは単なる新しい実験ですが、人工知能と分散型コラボレーションの交差点が加速しているという、より広範な傾向を浮き彫りにしています。新しいメカニズムが登場して成熟するにつれ、DAO はこれらの AI 概念にますます適応し、拡張することが予想されます。これらのイノベーションは特有の課題をもたらすため、今が準備を始める時期です。